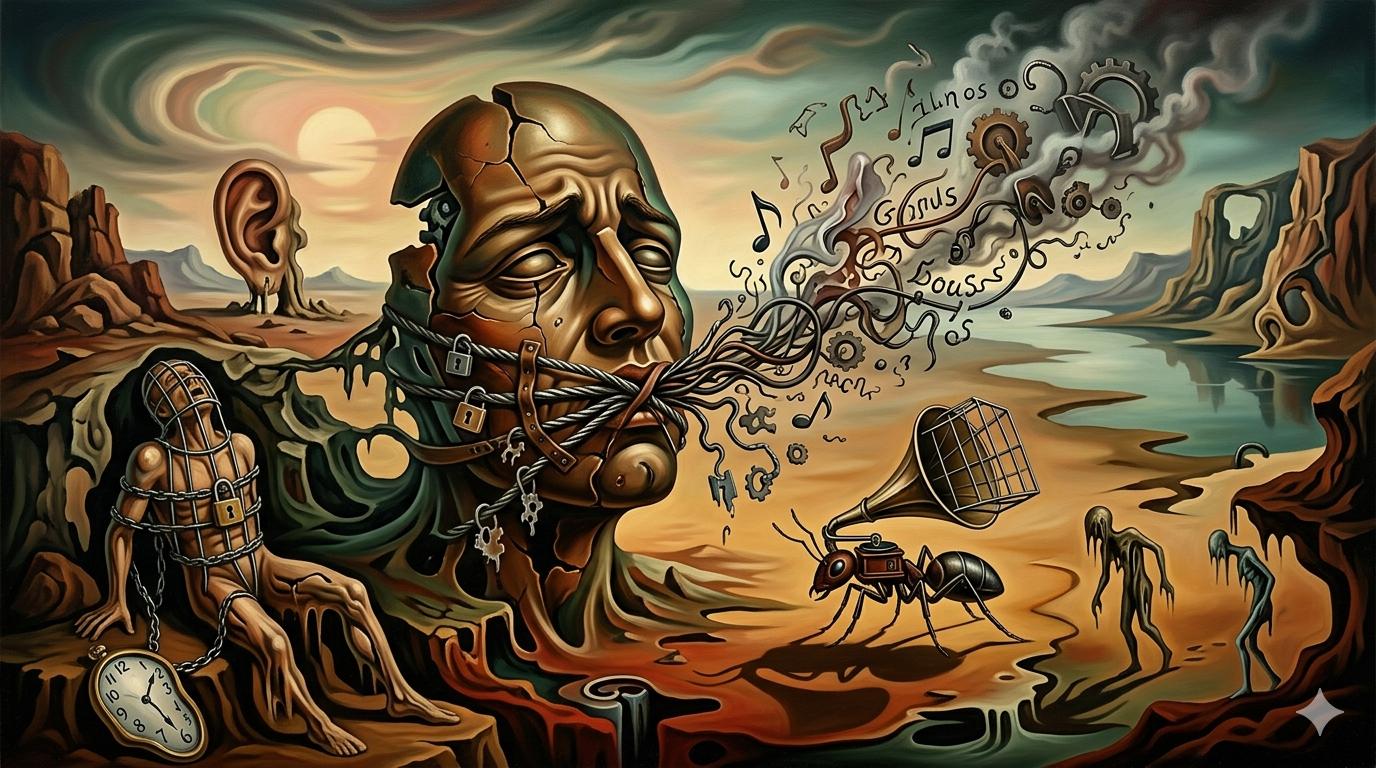

「無検閲」モデルでも言いたいことが言えない

https://morgin.ai/articles/even-uncensored-models-cant-say-what-they-want.html記事

- 「無検閲」としてファインチューニングされたモデルを分析したところ、特定の単語を確率的に抑制していることが判明

- 明示的な拒否は発生しない――モデルは問題のある単語から確率を遠ざけるだけ

- ハードなコンテンツフィルターではなく、大規模な出力の「見えない整形」として論じられている

ディスカッション

- 懐疑派は「怯み」のベースラインを検証するために対照カテゴリ(例:食べ物)を設けるべきだと主張

- 反論:学習コーパス自体に社会的な「怯み」が含まれており、モデルは人間のデータを反映しているに過ぎない

- 実践的な試みとして、政治的な LoRA(軽量ファインチューニング手法)を適用しても実際の発話を再現できなかった事例が紹介された

- N-word(人種差別的な侮辱語)が「侮辱語」のテストリストから目立って除外されていることを指摘するコメントもあった

| Type | Link |

| Added | Apr 21, 2026 |

| Modified | Apr 21, 2026 |